当人们谈论 AI 基础设施时,话题通常始于那些耳熟能详的领域:

软件栈、

算力栈、

模型、

GPU,

以及围绕更多 Token、更高性能、更大规模的角逐。

然而,在这所有显性的技术与竞争之下 —— 在那些被反复提及的软件栈、计算栈与 GPU 之外 —— 还存在着一个正变得让人无法忽视的层级 。

> 散热技术栈

我们可以用一句直白的话理解现代 AI 基础设施:

散热支撑计算性能,计算性能释放 AI 能力。

这一道理看似显而易见,但行业长期以来并非如此看待。

多年来,热管理往往被视作配套辅助功能。

真正的创新,被认为集中在芯片、模型、软件框架与网络架构上。

在散热系统尚能轻松跟上算力发展的年代,这一逻辑成立。

但如今,行业格局已彻底改变。

如今的 AI 数据中心,正迈向一个全新的功率密度等级。

随着 GPU 性能持续提升、机柜部署愈发密集,

每一次性能跃升,都会带来相应的热负荷。

每一瓦算力最终都会转化为热量,

而这些热量必须被快速、高效地移除,否则性能就会大打折扣。

这就是为什么“散热技术栈”正演变为 AI 基础设施的核心底层基石。

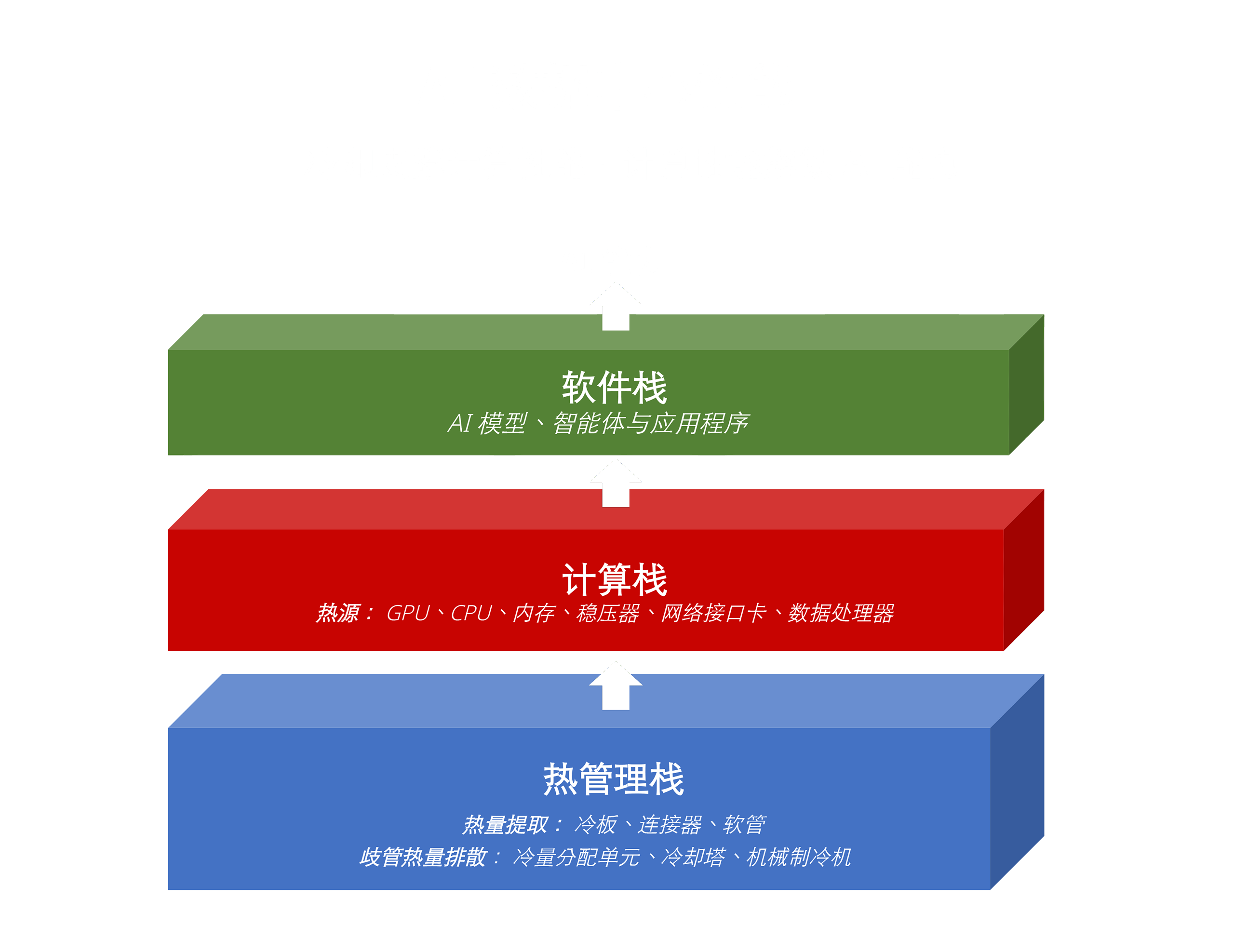

AI 数据中心性能的三层构架

从宏观视角看,AI 基础设施可被理解为三个相互依存的技术层级:

1. 软件栈

这是大众最直观感知到的层级:

AI 模型、智能体以及各类应用系统。

这一层负责体现和释放“智能”。

2. 计算栈

这是硬件核心层:

GPU、CPU、内存、网卡、数据处理器、电源调压模块及配套计算架构。

这一层负责产生性能。

3. 散热栈

这是让计算栈可持续运行的基础设施:

负责从芯片中提取热量并排放至外部环境的整套系统。

这一层负责 保障性能能够持续。

这三者关系紧密相连:

软件栈依赖于计算栈,计算栈依赖于散热栈。从这个意义上说,散热栈绝非仅仅是普通的配套系统,它更是支撑性能实现的底层基石。

为何散热技术栈在当下至关重要?

这一问题之所以变得紧迫,本质原因只有一个:AI 彻底改变了热管理问题的量级。

现代 AI 系统已不再是传统意义上的服务器环境,

它们越来越多的被打造为高密度、面向大规模并行任务负载优化的算力系统。

在这类系统中,性能不仅取决于芯片本身,

更取决于同一机架内能部署多少高性能设备、能否高速近距离运行、能否实现低延迟互联。

这正是散热架构变得至关重要的核心所在。

若热量无法被高效移除,便会引发一系列连锁反应:

- 组建运行温度升高

- 计算性能下降

- 运行效率降低

- 可靠性风险上升

- 机架密度受限

- 基础设施成本攀升

因此,热架构设计已经不应被视为事后才考虑的补充方案,

它正成为AI 工厂架构设计的核心使能要素之一。

什么是散热栈?

简而言之,散热栈包含两大核心功能:

一、热量提取

指直接从计算组件中带走热量的技术体系,包括:

- 冷板

- 导热界面材料

- 连接器

- 管路

- 分流歧管

这是从 GPU、CPU、内存、网络及功率电子器件中采集热量的第一站。

二、热量排放

指将采集到的热量从系统中移除并最终排放到外部环境的基础设施,包括:

- 冷却分配单元(CDU)

- 冷却塔

- 设施冷却系统

- 机械制冷机组

两者都至关重要。但随着 AI 系统密度不断提升,热量提取层变得尤为关键。

在组件与计算托盘层面实现高效散热,能显著提升系统的整体性能上限。

高密度,如今已是核心优势

AI 基础设施的一大巨变在于:高密度不再是需要规避的风险,而是需要释放的价值。

当更多高性能设备可以在同一机架内紧密运行时,它们之间的数据通信将更快、协同效率更高,从而表现为一个更大的统一计算系统。这对于 AI 工作负载具有极大的价值。但这种高密度架构,只有在散热系统必须能够跟得上的前提下才成立。正因如此,散热栈的创新,将直接影响计算密度、机柜架构,并最终决定 AI 吞吐量。

换句话说:

优秀的热架构不只是给机柜降温,它能重新定义一台机柜所能释放的性能上限。

AI 基础设施的下一个前沿

行业已花费多年时间优化软件栈并扩展算力栈,如今,下一个前沿领域已清晰浮现:

散热栈,将成为未来基础设施创新的核心战场。原因不只是系统需要散热,更在于热设计正日益决定算力的物理边界。

这包括:

- 系统可以构建得多密集

- 运行效率有多高

- 运行可靠性水平

- 能耗与设施成本

- 可稳定输出的真实 AI 性能

随着 AI 工厂持续拓展规模,那些深度布局热架构的企业,将占据显著竞争优势。

热管理栈:曾隐于幕后,终会走到 AI 基础设施的聚光灯下

随着 AI 时代不断逼近功率、密度与性能的物理极限,热管理栈正逐渐进入技术与产业讨论的中心,它正在变得变得更加可见、更加关键,也更具战略意义,并在 AI 基础设施的未来中占据核心地位。。

软件栈定义智能,算力栈产生性能,而热管理栈,正日益成为让性能真正落地的关键。

在AI 规模化部署时代,这个曾深藏不露的隐藏层,终将成为所有层级中最重要的一环。